使用iostat查看linux硬盘IO性能的方法

IO等待所占用的CPU时间的百分比,高过30%时IO压力高其次、用iostat -x 1 10

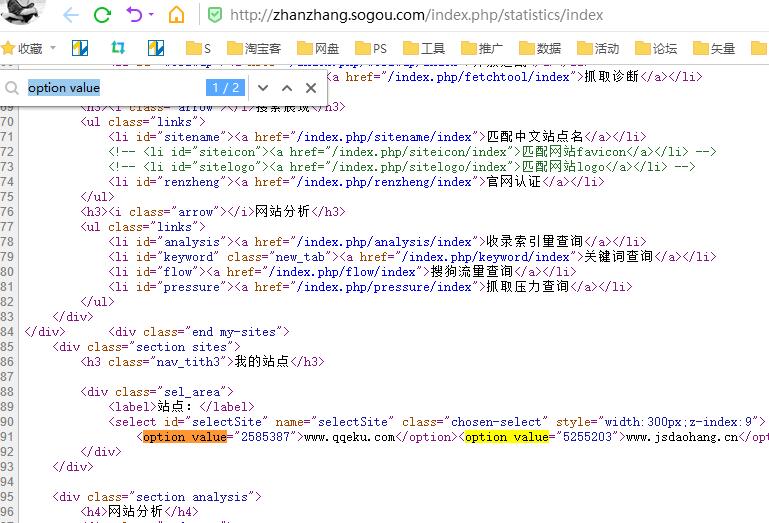

![使用iostat查看linux硬盘IO性能的方法 [db:标签] 碎碎语 第1张 使用iostat查看linux硬盘IO性能的方法 [db:标签] 碎碎语 第1张](http://www.jsdaohang.cn/upload/2022/1114/23250ad09a4a3637fee4630792187704.png)

[root@controller~]#iostat-d-k110Device:tpskB_read/skB_wrtn/skB_readkB_wrtnsda19.000.00112.000112sda10.000.000.0000sda20.000.000.0000sda30.000.000.0000sda40.000.000.0000sda53.000.0016.00016sda60.000.000.0000sda716.000.0096.00096

tps:该设备每秒的传输次数,一次传输的意思是“一次I/O请求”

kB_read/s:每秒从设备读取的数据量

kB_wrtn/s:每秒向设备写入的数据量

kB_read:读取的总数据量

kB_wrtn :写入的总数量数据量

使用-x获得更多信息

使用-x获得更多信息

查看设备使用率(%util)、响应时间(await)

[root@controller~]#iostat-d-x-k110Device:rrqm/swrqm/sr/sw/srkB/swkB/savgrq-szavgqu-szawaitsvctm%utilsda0.0022.000.0018.000.00160.0017.780.073.783.786.80sda10.000.000.000.000.000.000.000.000.000.000.00sda20.000.000.000.000.000.000.000.000.000.000.00sda30.0015.000.002.000.0068.0068.000.016.506.501.30sda40.000.000.000.000.000.000.000.000.000.000.00sda50.000.000.000.000.000.000.000.000.000.000.00sda60.000.000.000.000.000.000.000.000.000.000.00sda70.007.000.0016.000.0092.0011.500.063.443.445.50

rrqm/s:每秒进行merge的读操作数目。即delta(rmerge)/s

wrqm/s:每秒进行merge的写操作数目。即delta(wmerge)/s

r/s:每秒完成的读I/O设备次数。即delta(rio)/s

w/s:每秒完成的写I/O设备次数。即delta(wio)/s

rsec/s:每秒读扇区数。即delta(rsect)/s

wsec/s:每秒写扇区数。即delta(wsect)/s

rkB/s:每秒读K字节数。是rsect/s的一半,因为每扇区大小为512字节。(需要计算)

wkB/s:每秒写K字节数。是wsect/s的一半。(需要计算)

avgrq-sz:平均每次设备I/O操作的数据大小(扇区)。delta(rsect+wsect)/delta(rio+wio)

avgqu-sz:平均I/O队列长度。即delta(aveq)/s/1000(因为aveq的单位为毫秒)。

await:平均每次设备I/O操作的等待时间(毫秒)。即delta(ruse+wuse)/delta(rio+wio)

svctm:平均每次设备I/O操作的服务时间(毫秒)。即delta(use)/delta(rio+wio)

%util:一秒中有百分之多少的时间用于I/O操作,或者说一秒中有多少时间I/O队列是非空的。即delta(use)/s/1000(因为use的单位为毫秒)

如果%util接近100%,说明产生的I/O请求太多,I/O系统已经满负荷,该磁盘可能存在瓶颈。

idle小于70%IO压力就较大了,一般读取速度有较多的wait.

同时可以结合vmstat查看查看b参数()和wa参数()

另外还可以参考

svctm 一般要小于await(因为同时等待的请求的等待时间被重复计算了),svctm 的大小一般和磁盘性能有关,CPU/内存的负荷也会对其有影响,请求过多也会间接导致svctm的增加。await 的大小一般取决于服务时间(svctm)以及I/O队列的长度和I/O请求的发出模式。如果svctm比较接近await,说明I/O 几乎没有等待时间;如果await远大于svctm,说明I/O 队列太长,应用得到的响应时间变慢,如果响应时间超过了用户可以容许的范围,这时可以考虑更换更快的磁盘,调整内核elevator 算法,优化应用,或者升级CPU。

队列长度(avgqu-sz)也可作为衡量系统I/O负荷的指标,但由于avgqu-sz是按照单位时间的平均值,所以不能反映瞬间的I/O洪水。

别人一个不错的例子.(I/O系统vs.超市排队)

举 一个例子,我们在超市排队checkout时,怎么决定该去哪个交款台呢?首当是看排的队人数,5个人总比20人要快吧? 除了数人头,我们也常常看看前面人购买的东西多少,如果前面有个采购了一星期食品的大妈,那么可以考虑换个队排了。还有就是收银员的速度了,如果碰上了连 钱都点不清楚的新手,那就有的等了。另外,时机也很重要,可能5 分钟前还人满为患的收款台,现在已是人去楼空,这时候交款可是很爽啊,当然,前提是那过去的5分钟里所做的事情比排队要有意义 (不过我还没发现什么事情比排队还无聊的)。

I/O系统也和超市排队有很多类似之处:

r/s+w/s类似于交款人的总数

平均队列长度(avgqu-sz)类似于单位时间里平均排队人的个数

平均服务时间(svctm)类似于收银员的收款速度

平均等待时间(await)类似于平均每人的等待时间

平均I/O数据(avgrq-sz)类似于平均每人所买的东西多少

I/O操作率(%util)类似于收款台前有人排队的时间比例。

我们可以根据这些数据分析出I/O请求的模式,以及I/O的速度和响应时间。

%util:在统计时间内所有处理IO时间,除以总共统计时间。例如,如果统计间隔1秒,该设备有0.8秒在处理IO,而0.2秒闲置,那么该设备的%util = 0.8/1 = 80%,所以该参数暗示了设备的繁忙程度。一般地,如果该参数是100%表示设备已经接近满负荷运行了(当然如果是多磁盘,即使%util是100%,因为磁盘的并发能力,所以磁盘使用未必就到了瓶颈)。)

部署一个程序时(我测试的是一个实时上传日志的程序),对系统的cpu、内存、io等都要有所考虑,保证系统高效的运行。

如果程序本身处理的包特别小,事件很多,压力大且没有间隔的话,占用CPU的资源会很多

如果用磁盘缓存,不用内存缓存的话,能够支持断点重传,保证数据的可靠性上传,如突然断电等情况,存入磁盘缓存的数据等到恢复后会依然上传,而不会丢失,但是相对的也会增加读写磁盘的次数,如果数据量比较小,速度还是可以忍受的。

下面是别人写的这个参数输出的分析

#iostat-x1avg-cpu:%user%nice%sys%idle16.240.004.3179.44Device:rrqm/swrqm/sr/sw/srsec/swsec/srkB/swkB/savgrq-szavgqu-szawaitsvctm%util/dev/cciss/c0d00.0044.901.0227.558.16579.594.08289.8020.5722.3578.215.0014.29/dev/cciss/c0d0p10.0044.901.0227.558.16579.594.08289.8020.5722.3578.215.0014.29/dev/cciss/c0d0p20.000.000.000.000.000.000.000.000.000.000.000.000.00

上面的iostat输出表明秒有28.57次设备I/O操作:总IO(io)/s=r/s(读)+w/s(写)=1.02+27.55=28.57(次/秒)其中写操作占了主体(w:r=27:1)。

平均每次设备I/O操作只需要5ms就可以完成,但每个I/O请求却需要等上78ms,为什么?因为发出的I/O请求太多(每秒钟约29个),假设这些请求是同时发出的,那么平均等待时间可以这样计算:

平均等待时间=单个I/O服务时间*(1+2+…+请求总数-1)/请求总数

应用到上面的例子:平均等待时间=5ms*(1+2+…+28)/29=70ms,和iostat给出的78ms的平均等待时间很接近。这反过来表明I/O是同时发起的。

每秒发出的I/O请求很多(约29个),平均队列却不长(只有2个左右),这表明这29个请求的到来并不均匀,大部分时间I/O是空闲的。

一秒中有14.29%的时间I/O队列中是有请求的,也就是说,85.71%的时间里I/O系统无事可做,所有29个I/O请求都在142毫秒之内处理掉了。

delta(ruse+wuse)/delta(io) =await=78.21=>delta(ruse+wuse)/s=78.21*delta(io)/s= 78.21*28.57=2232.8,表明每秒内的I/O请求总共需要等待2232.8ms。所以平均队列长度应为 2232.8ms/1000ms=2.23,而iostat给出的平均队列长度(avgqu-sz)却为22.35,为什么?!因为 iostat中有bug,avgqu-sz值应为2.23,而不是22.35。

以上使用iostat查看linux硬盘IO性能的方法就是小编为大家收集整理的全部内容了,希望对大家有所帮助。如果您喜欢这篇文章,可以收藏或分享给您的小伙伴们吧!欢迎持续关注我们的后续更新。